深度学习编译加速与模型优化实战精要

|

深度学习模型在实际部署中常面临推理速度慢、资源消耗高的问题。编译加速与模型优化是解决这一难题的核心手段。通过合理的工具链与策略,可以在不牺牲精度的前提下显著提升模型运行效率。 编译加速的关键在于将高层神经网络描述转化为高效可执行的底层代码。主流框架如TensorFlow、PyTorch均支持通过XLA(Accelerated Linear Algebra)或TorchScript进行图级优化。这些技术能在编译阶段融合算子、消除冗余计算,并自动选择最优内核实现,大幅降低运行时开销。

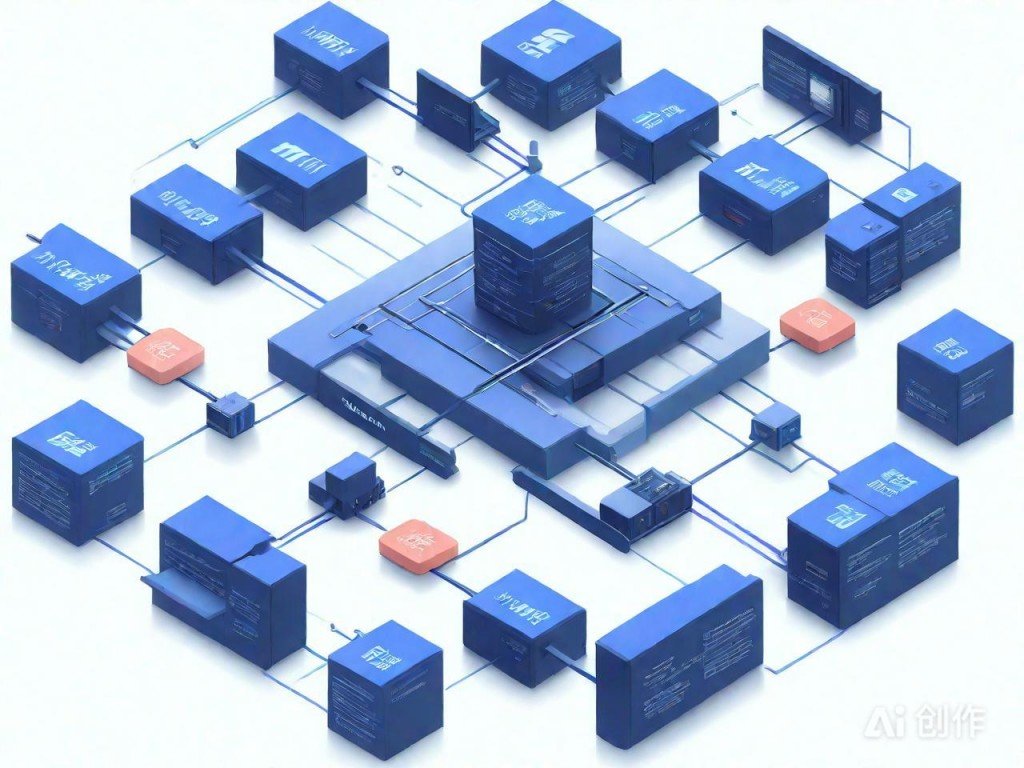

2026配图由AI绘制,仅供参考 模型量化是另一项核心优化技术。通过将浮点数权重和激活值转换为低精度格式(如INT8),可减少内存占用并加速计算。现代推理引擎如TensorRT、OpenVINO均提供自动量化功能,结合校准数据可有效控制精度损失,通常在误差可控范围内实现2-4倍的性能提升。剪枝技术则从结构层面精简模型。通过移除冗余权重或通道,可构建更轻量的网络。静态剪枝在训练后直接删除小权重,动态剪枝则在推理过程中按需激活部分路径。结合量化使用,剪枝能进一步压缩模型体积,适合边缘设备部署。 算子融合与图重写也是重要环节。多个连续算子可被合并为单一操作,减少内存访问与调度开销。例如,将卷积+批归一化+激活函数融合为一个复合算子,能显著提升执行效率。现代编译器如MLIR支持灵活的中间表示与自定义优化规则,为定制化优化提供了强大支撑。 实战中,建议采用“量化+剪枝+编译优化”三步法:先对模型进行量化处理,再实施结构化剪枝,最后通过目标平台专用编译器完成最终优化。整个流程应配合真实场景测试,确保性能与准确率平衡。合理利用开源工具链,可快速实现从训练模型到高效部署的跨越。 (编辑:站长网) 【声明】本站内容均来自网络,其相关言论仅代表作者个人观点,不代表本站立场。若无意侵犯到您的权利,请及时与联系站长删除相关内容! |